Ollama

OllamaはローカルでLLMを実行できるツールである。

Ollamaとは?

Ollamaは、最近AI/LLM開発者の間でよく使われているツールである。

Ollamaは、ローカル環境で大規模言語モデル(LLM)を簡単に実行・管理できるオープンソースプラットフォームである。

つまり、OpenAI APIのようなクラウドモデルを使わなくても、**自分のPC(Mac/Linux/Windows)**でLlama、Mistral、Gemma、CodeLlamaなどのモデルを読み込んで使用できる。

Ollamaの主な特徴

- ローカル実行をサポート

- インターネット接続なしでもモデルを実行可能

- 企業セキュリティや個人のプライバシーに有利

- 簡単なモデル配布

ollama run llama3のような1行のコマンドでモデルを実行- Dockerのようにモデルパッケージ管理をサポート(

Modelfileという設定ファイルで管理)

- 複数モデルをサポート

- Meta LLaMA、Mistral、Gemma、Code Llama、Phiなど多様なモデルをダウンロードして実行可能

- API提供

- REST API形式でローカルサーバー(

http://localhost:11434/api/generate)を開き、他のアプリから呼び出し可能 - ローカルOpenAI APIサーバーのように活用可能

- REST API形式でローカルサーバー(

- GPU最適化

- MPS(Mac)、CUDA(NVIDIA GPU)をサポートし高速

- CPUでも実行可能だが速度は低下する

Ollamaの使用

インストール

- macOS/Linux/Windows向けパッケージも提供

- macOS

brew install ollama

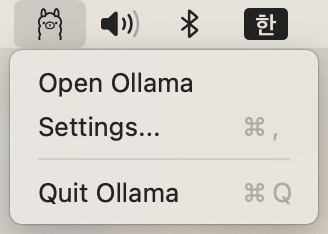

macOSでインストール完了後に実行すると、メニューバーにOllamaアイコンが表示される。

モデル実行

ollama run llama3

初回実行時はモデルを自動ダウンロードしてから実行する。llama3モデルの容量は4.7GB。

モデルのダウンロード

公式サイトで使用するmodelを検索し、気に入ったモデルをインストールする。

- 推奨モデル

- https://www.ollama.com/library/gpt-oss

- ChatGPTレベルのチャット、分析、業務などを望む場合に使用する。MacBookでは少し遅いが動作は良好。

- https://www.ollama.com/library/phi4-mini

- 単純なMCP server呼び出し対象探索などの簡単な作業に向いている。toolsをサポートする軽量モデルならどれでもよい。qwen、deepseekは使用禁止。

- https://www.ollama.com/library/gpt-oss

API呼び出し(例: curl)

curl http://localhost:11434/api/generate -d '{

"model": "llama3",

"prompt": "Explain quantum computing in simple terms"

}'

モデル管理

ollama list-> インストール済みモデルを確認ollama pull mistral-> 新しいモデルをダウンロードollama create mymodel -f Modelfile-> カスタムモデルを作成

Ollamaと他のLLM実行フレームワークの比較

| ツール | 特徴 |

|---|---|

| Ollama | 最も簡単なインストール/実行、ローカルAPI提供、モデルパッケージ管理 |

| LM Studio | GUIベース、モデル選択と実行が直感的 |

| vLLM | 高性能サーバー実行に最適化、主に大規模デプロイで使用 |

| Text Generation WebUI | 多様なモデル実行 + Web UI提供 |

| OpenAI API | クラウドベースで最新モデルを使用可能。ただし費用/プライバシーの問題あり |

活用事例

- 開発環境でローカルAIアシスタントを構築

- 社内セキュリティデータと接続した内部チャットボット

- LangChain、LlamaIndexのようなフレームワークと連携してRAGシステムを構築

- プロトタイピング: OpenAI API費用を使わず素早く実験

まとめ

Ollamaはローカルで簡単にLLMを実行できる「LLMのDocker」のようなプラットフォームである。個人研究から企業向けチャットボットまで幅広く使える。