MCP (Model Context Protocol)

MCP 개요

Model Context Protocol(MCP)는 AI, 특히 대규모 언어 모델(LLM)이 외부 데이터 소스 및 도구와 효과적으로 상호작용하도록 돕는 오픈 표준 프로토콜이다.

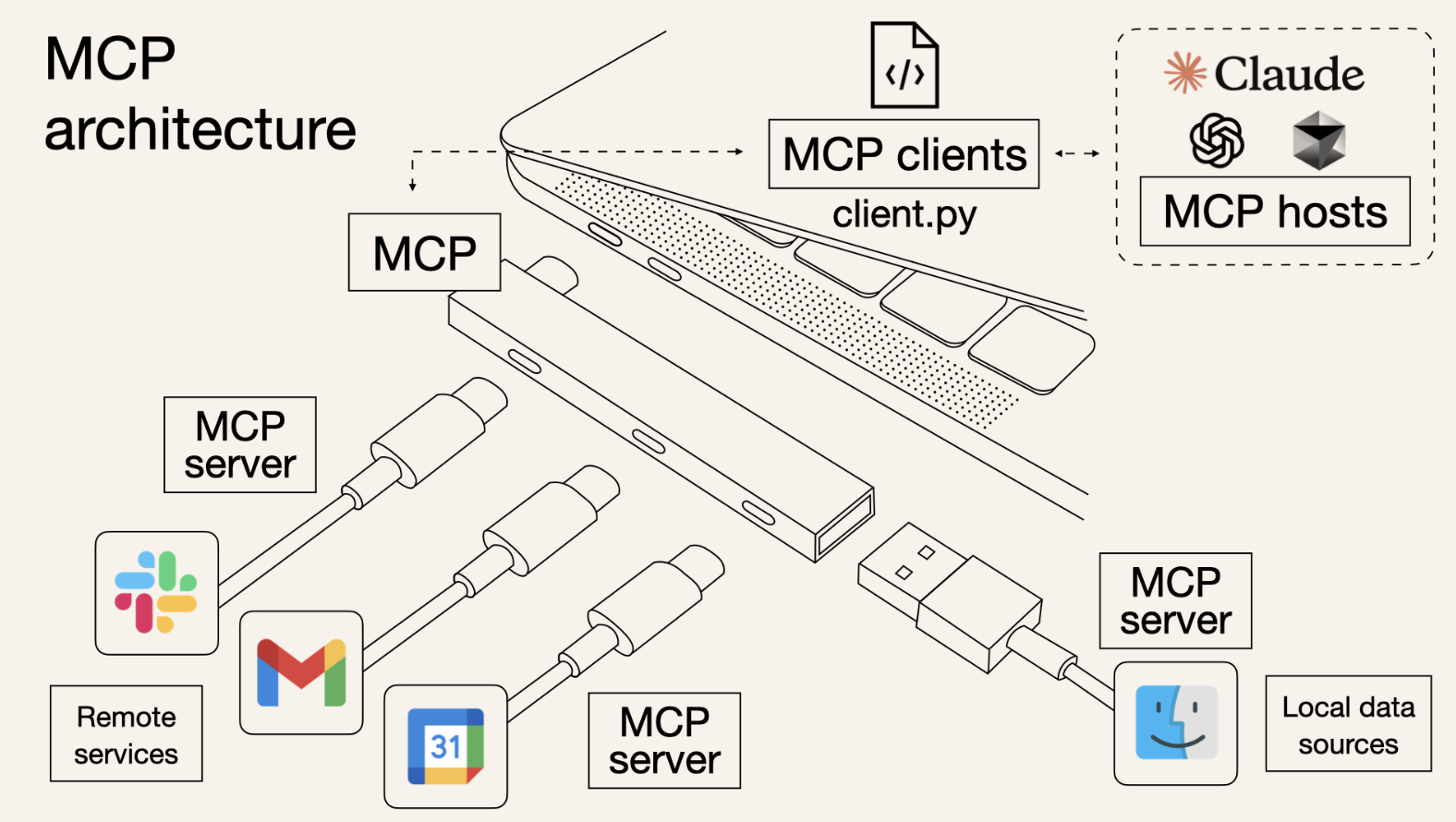

이 프로토콜은 애플리케이션이 LLM에 컨텍스트(Context)를 일관된 방식으로 전달할 수 있도록 설계되었다. 한마디로, AI용 USB-C 포트라는 은유로 설명되기도 한다. 이는 USB-C가 여러 장치를 통일된 포맷으로 연결하듯, MCP도 AI 모델과 다양한 리소스를 표준화된 방식으로 연결해 준다.

즉, AI 모델이 다양한 외부 시스템과 연결될 수 있도록 해주는 공용 인터페이스이다.

주요 특징

-

표준화된 인터페이스

- 모델이 “데이터 소스 / 도구 / 애플리케이션"에 접근할 수 있는 공용 규약 제공.

-

플러그형 구조

- 특정 애플리케이션에 종속되지 않고, 어떤 모델이든 MCP를 지원하면 같은 방식으로 확장 가능.

-

보안 & 제어

- 모델이 접근할 수 있는 범위를 제한하고, 사용자가 허용한 리소스에만 접근하도록 설계.

-

개발자 친화적

- OpenAI, Anthropic 같은 여러 AI 모델에서 공용으로 사용 가능 → “한번 만든 MCP 도구는 어디서든 사용”.

예시

-

모델이 “데이터베이스 질의"가 필요할 때:

모델 → MCP → DB Adapter → Database -

모델이 “웹 API 호출"을 해야 할 때:

모델 → MCP → HTTP Adapter → 외부 REST API

즉, MCP는 AI의 플러그인 생태계를 표준화하는 기반 기술이라고 볼 수 있다.

도입 배경과 필요성

AI 모델은 본질적으로 텍스트 기반으로만 입출력을 한다. 그러나 실제 활용에서는 DB 조회, API 호출, 파일 입출력 등 다양한 작업이 필요하다. 지금까지는 플러그인, LangChain, 자체 API 브릿지 같은 개별 솔루션을 써야 했는데, 이들을 표준화된 프로토콜로 묶은 것이 MCP이다.

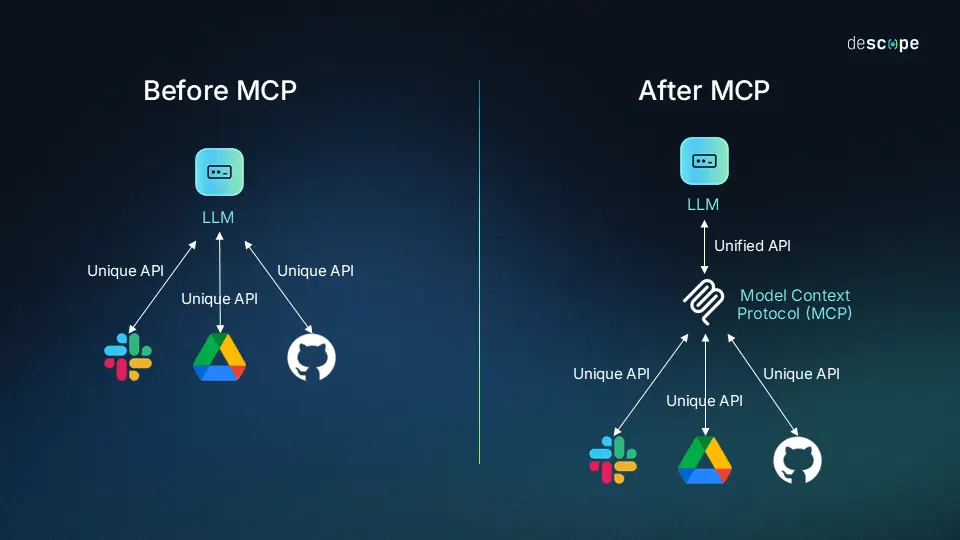

기존에는 AI 애플리케이션이 외부 시스템과 상호작용하기 위해, 모델마다, 도구마다 각각 맞춤형 통합 구현이 필요했다. 이로 인해 개발 및 유지보수의 복잡성이 크게 증가했고, 이를 M×N 문제라고 표현했다. MCP는 이를 M+N 구조로 단순화하여, AI 애플리케이션이 다양한 도구와 표준화된 방식으로 연결될 수 있도록 지원한다.

아키텍처 및 작동 원리

클라이언트-서버 구조

MCP는 클라이언트-서버 아키텍처를 채택하고 있으며,

- MCP 클라이언트는 AI 애플리케이션(예: Claude Desktop)이다.

- MCP 서버는 파일 시스템, 데이터베이스, API 등 외부 리소스를 제공한다.

통신 방식

MCP는 JSON-RPC 2.0 기반으로 요청(Request)과 응답(Response)을 교환하며, 이는 표준화된 메시지 교환 방식을 통해 상호운용성을 향상시킨다. 또한, **로컬 프로세스 간 통신(stdio 기반)**과 HTTP + SSE(서버 전송 이벤트) 기반 통신을 모두 지원한다.

서버의 역할

MCP 서버는 다음과 같은 기능을 수행한다.

- Tool Registry: 사용 가능한 툴 및 기능의 목록 관리

- Authentication: 접근 권한 검증

- Request Handler: 클라이언트의 요청 처리

- Response Formatter: 결과를 AI 모델이 이해할 수 있는 형식으로 가공

AI 애플리케이션은 서버에 “사용 가능한 도구 목록"을 요청하고, 이를 바탕으로 적절한 툴을 선택하고 활용할 수 있다.

개발자 친화성과 확장성

Anthropic은 MCP를 오픈소스 표준으로 공개하였으며, Python, TypeScript, Java, Kotlin, C# 등 주요 언어용 SDK도 제공하고 있다. 이를 통해 클라이언트 및 서버 구현이 대체로 간단하다는 장점을 얻을 수 있다

활용 효과 및 이점

- 명확한 지시: LLM이 어떤 데이터를 취급할지 명확히 지정 가능

- 불명확성 제거: 여러 정보원을 명확히 구분하여 참조 가능

- 특화된 처리 지원 가능: 특정 데이터 형식에 맞춘 전용 처리가 가능

- 컨텍스트 예시: 파일 시스템, DB, 클라우드 서비스 등 다양한 컨텍스트를 함께 활용 가능

이러한 이점 덕분에, AI의 활동 범위가 확장되고, 더 정확하고 문맥에 맞는 응답을 제공할 수 있게 된다.

도입 시기 및 생태계 동향

- MCP는 2024년 11월에 Anthropic이 오픈소스로 공개하였으며, 2025년 초부터 개발자 커뮤니티와 주요 AI 도구들에서의 채택이 급속히 증가하였다.

- C#용 공식 SDK의 출시에 관한 언급도 있으며, 현재 수많은 MCP 서버가 운영 중이며, 보안 아키텍처 및 데이터 보호도 중요한 관심사로 자리 잡고 있다.

요약 표

| 항목 | 설명 |

|---|---|

| 정의 | AI 모델과 외부 데이터/도구를 연결하는 오픈 표준 프로토콜 |

| 도입 배경 | 개별 통합의 복잡성을 해소하고 더 유연한 확장성 확보 |

| 구조 | 클라이언트-서버 구조, JSON-RPC, 표준 메시지 교환 |

| SDK | Python, TS, Java, Kotlin, C# 등 제공 |

| 이점 | 명확성, 확장성, 자동화, 보안성 강화 등 |

| 현재 동향 | 공개 이후 급성장 중이며 보안 및 실용성 확대 중 |

궁금하신 부분이 더 있다면 언제든지 말씀해 주세요. 예를 들어, MCP 서버 직접 구축 사례나 기술 활용 흐름 등도 설명드릴 수 있습니다.